Нейросети: начало или что было до ChatGPT

Рассказываем, с чего началась история нейросетей и как игровая индустрия стала главным двигателем прогресса.

6К открытий17К показов

Нейросети стали трендом 2022 года и, кажется, продолжат своё активное развитие в 2023-м. Но с чего началась их история? В этой статье проследим за развитием нейросетей и узнаем, как игровая индустрия стала главным двигателем прогресса и почему чат-бот ChatGPT появился именно сейчас, а не 40 лет назад.

Первая революция: перцептрон и нейрокомпьютер «Марк-1»

Как вы могли догадаться из названия, концепция работы нейросетей базируется на устройстве мозга человека. Он состоит из нейронов, которые обмениваются между собой электрическими сигналами.

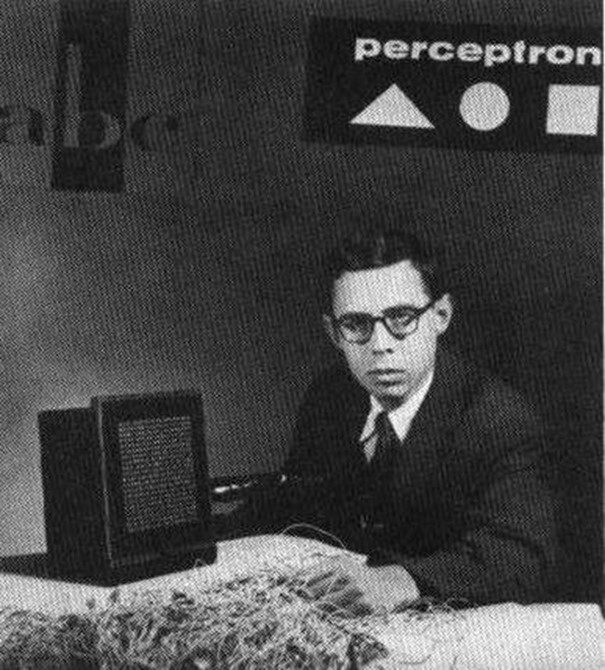

Создать машину, имитирующую функции человеческого мозга, учёные пытались с 40-х годов. Но первым, кому это удалось, стал нейрофизиолог Фрэнк Розенблатт. Его нейрокомпьютер «Марк-1», представленный в 1960 году, был основан на понятии перцептрона — базовой модели машинного обучения, которая определяет, относится ли объект к определённой категории.

Допустим, у нас есть фотография зелёного поля, как на известной заставке для Windows XP. Мы отмечаем облако на фото и спрашиваем у перцептрона: это небо или земля? Первый раз он отвечает наугад и говорит, что это земля. Мы подаём сигнал, что ответ неверный, и корректируем весовые коэффициенты связей между искусственными нейронами. А если область угадана правильно, ничего не меняем. Рано или поздно перцептрон поймёт, что сверху находится небо, а снизу — земля. Если показать ему другое фото, он вряд ли определит линию горизонта, но точно отличит верх от низа.

Нейроны компьютера «Марк-1» состояли не из строчек кода, а из радиоламп и резисторов. Задача устройства состояла в том, чтобы распознавать геометрические фигуры и буквы алфавита. Для начала 60-х это было выдающееся достижение, но его слишком активно стали рекламировать в прессе.

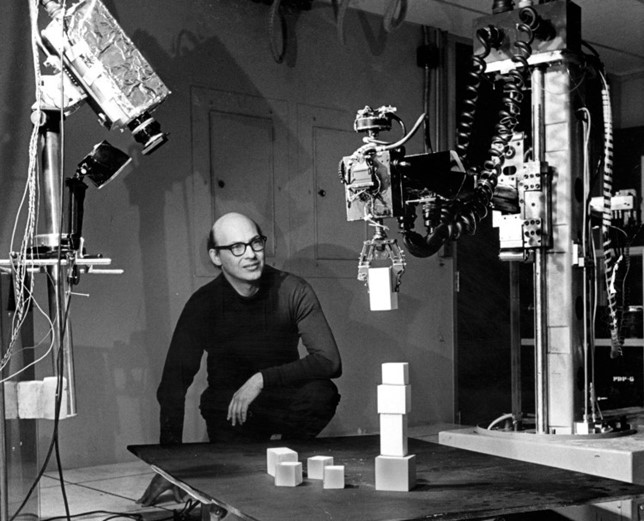

В New York Times писали, что уже через пару лет на базе «Марк-1» появятся компьютеры, способные мыслить, как человек. С этим утверждением не был согласен однокурсник Розенблатта — Марвин Минский. Он сам занимался машинным обучением, имел большой вес в научных кругах и даже был консультантом на съёмках фильма «2001 год: Космическая одиссея» Стэнли Кубрика. А ведь там был HAL 9000 — компьютер с искусственным интеллектом, способный

распознавать речь и зрительные образы, создавать предметы искусства и проявлять эмоции.

В 1969 Марвин Минский и Сеймур Паперт выпустили книгу

«Перцептрон», которая надолго отбила у научного сообщества желание заниматься развитием нейросетей.

В книге учёные доказали, что сеть «Марк-1» с двумя слоями

почти ничего не умела, а на многослойные сети алгоритмы Розенблатта перенести нельзя — часть информации об ошибках могла бы потеряться, не достигнув нужного слоя.

К сожалению, в 1971 году Розенблатт ушёл из жизни, и

дорабатывать устройство было некому. На волне развития классических компьютеров учёные перестали развивать концепцию искусственных нейронов, сконцентрировав силы на более перспективных направлениях.

Вторая революция: методобратного распределения ошибки

70-е годы XX века многие называют «зимой искусственного

интеллекта». Правительство США сократило финансирование этой области, а наука, казалось, стояла на месте. Но в 1986 году произошёл прорыв — появился способ машинного обучения по методу обратного распространения ошибки.

Он работает так: сначала нейронная сеть получает на вход

некоторые данные и на основе текущих весовых коэффициентов производит прогноз. Затем этот прогноз сравнивается с ожидаемым результатом, и вычисляется ошибка.

Ошибка распространяется обратно через сеть, влияя на каждый

нейрон по мере его удаления от выходного слоя. Это позволяет нейронной сети узнать, какие весовые коэффициенты нужно изменить, чтобы уменьшить ошибку.

После этого процесс повторяется для каждого примера данных в

обучающей выборке, и каждый раз нейронная сеть корректирует веса своих связей на основе ошибки, пока не достигнет достаточно высокой точности прогнозирования.

В 80-е уже никто не разрабатывал экспериментальные приборы:

проще было запрограммировать компьютер на нужные действия. Благодаря новому методу за пару лет нейронные сети научились искать на изображениях геометрические фигуры и распознавать почерк человека.

Вскоре появились и самообучающиеся нейронные сети, которые не

ждали подсказки от человека, а сами находили правильные ответы. Постепенно разработки стали использовать на практике: например, американские банки внедрили нейросеть, которая распознавала цифры на чеках.

Однако учёные столкнулись с проблемами: в 80-х годах ещё не

было вычислительных мощностей, способных обучать такие нейронные сети, а также больших объёмов данных, на которых они могли бы обучаться. Это привело к ещё одной «зиме искусственного интеллекта».

Третья революция: расцвет нейросетей

Несмотря на сокращение финансирования и относительное

затишье, в 90-е и начале 2000-х о нейросетях не забывали. Например, был создан метод опорных векторов — техника машинного обучения с учителем для задач классификации и регрессии.

Однако в конце 2000-х всё снова изменилось. Появились

вычислительные мощности, которых не хватало для развития нейросетей. Импульсом для этого стало развитие игровой индустрии — игры становились всё сложнее и требовали мощных видеокарт. Оказалось, что геймерские видеокарты отлично подходят для обучения искусственного интеллекта.

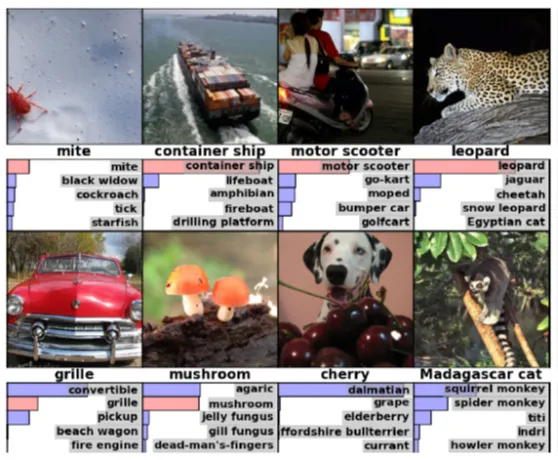

В 2012 году произошло знаковое событие для мира нейросетей.

На конкурсе по распознаванию объектов на изображениях ImageNet LSVRP победила нейросеть AlexNet с набором данных ImageNet.

Нейросеть сделала всего 16,4% ошибок, тогда как программа,

занявшая второе место, ошиблась в 26% случаев. При этом человек обычно совершает ошибки в 5% случаев.

Самое интересное, что для обучения нейросети-победителя

использовали обычный компьютер с двумя видеокартами NVIDIA. На тренировки ушла примерно неделя. База данных для обучения нейросети включала 15 миллионов изображений, распределённых по 22 000 категорий. В неё входили как стандартные объекты вроде машин или домов, так и триста пород собак.

Попробуйте отличить их самостоятельно, особенно зная, что

есть около 20 разновидностей терьеров ?

Спустя 10 лет нейросети не просто распределяют фотографии по

категориям, но и сами создают их по текстовым описаниям. Думаем, вы уже пользовались Midjourney, DALL-E или Stable Diffusion.

В итоге всё это привело к появлению на свет в 2020 году модели GPT-3, разработанной компанией OpenAI. GPT-3 использует технологию

transformer для генерации текста. Эта модель обучается на огромном количестве текстовых данных, таких как книги, статьи, новости и интернет-контент. Она может предсказывать следующее слово в тексте на основе контекста, что позволяет ей генерировать связный текст, который выглядит так, как будто он написан человеком.

При обучении этой модели уже нельзя было ограничиться

компьютером с двумя видеокартами. OpenAl использовала кластер из 35 580 GPU и 2,6 миллиона ядер процессора. А в ноябре 2022 года всему миру стал доступен сервис ChatGPT на основе GPT-3, который ознаменовал начало четвёртой революции нейросетей.

Что ждёт нас за горизонтом? Потеря рабочих мест и восстание машин? Или мир, в котором нейросети делают нашу жизнь комфортнее? В

такой быстро меняющейся сфере трудно давать прогнозы. Будущее происходит на наших глазах — остаётся только следить за ним.

6К открытий17К показов