Выпущена Adversarial Robustness Toolbox, открытая библиотека от IBM для защиты ИИ

Новости

Новый инструмент от IBM позволит разработчикам ИИ выполнять тестирование DNN-сетей. Пакет включает всё необходимое для проверки и работы с сетями.

697 открытий777 показов

IBM Research запустила библиотеку Adversarial Robustness Toolbox с целью помочь разработчикам и исследователям в области искусственного интеллекта обеспечить безопасность используемых нейросетей. Код написан на Python и выложен в репозитории на GitHub. Релиз включает в себя документацию и мануалы для быстрого старта.

Проект содержит всё необходимое для тестирования системы безопасности нейросетей глубокого обучения (DNN): агенты для атаки, утилиты для защиты и методы аналитики. Особенностью данных сетей является их уязвимость к так называемым «состязательным» атакам.

В чём опасность?

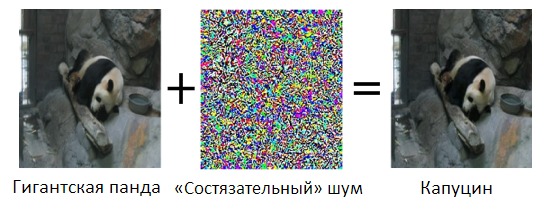

Принцип действия «состязательных» атак заключается во внедрении намеренно изменённых изображений для получения нужного результата на выходе. Последствиями подобных «инъекций» являются проблемы с идентификацией объекта, ошибочная работа нейросети и ложное обучение нейронов. Внедряемое изображение может быть просто шумом, никак не влияющим на видимую человеку картинку, однако приводить к искажённым результатам.

Угрозы безопасности также включают в себя спуфинг GPS и обход системы защиты спутников на основе искусственного интеллекта. Злоумышленники в состоянии использовать эти уязвимости для перенаправления корабельных курсов и получения доступа к бортовым системам. К тому же DNN-сети могут быть особенно уязвимы в беспилотных автомобилях и военных дронах. По словам разработчиков, AR Toolbox способен предотвратить эти и многие другие проблемы, связанные с использованием ИИ.

Как работает защита?

Использование библиотеки от IBM в отношении нейросетей похоже на тренировку бойца смешанных единоборств. Система оценивает общий уровень подготовки DNN-сети, обучает индивидуальным способам отражения атак, тем самым создавая внутреннюю антивирусную базу.

Одной из самых больших проблем среди существующих моделей для защиты от «состязательного» искусственного интеллекта – то, что они сильно зависят от платформы. Команда IBM создала Adversarial Robustness Toolbox, который может обучиться для любой платформы. Независимо от того, будете ли вы кодировать/разрабатывать в Keras или в TensorFlow, вы сможете применить одну и ту же библиотеку для создания защиты.

Доступность библиотеки

Первый релиз поддерживает нейросети, реализованные в TensorFlow и Keras. Разработчики обещают в обновлениях расширить совместимость на такие популярные платформы, как PyTorch и MXNet. На момент написания новости библиотека предназначена в первую очередь для повышения устойчивости систем визуального распознавания, однако ведется работа над будущими релизами, которые будут включать адаптацию к другим режимам данных, таким как речь, текст или временные ряды.

Это не единственный вклад IBM в развитие искусственного интеллекта. Напомним, что в марте 2018 года компания представила облачный сервис машинного обучения для разработчиков ИИ.

697 открытий777 показов