Исследователи разработали чат-бота, который убежден в своей правоте

Новости

Visual Chatbot, который обучен на изображениях людей и животных, впадает в ступор при виде необычных картинок. Если он ошибается, не хочет этого признавать.

891 открытий910 показов

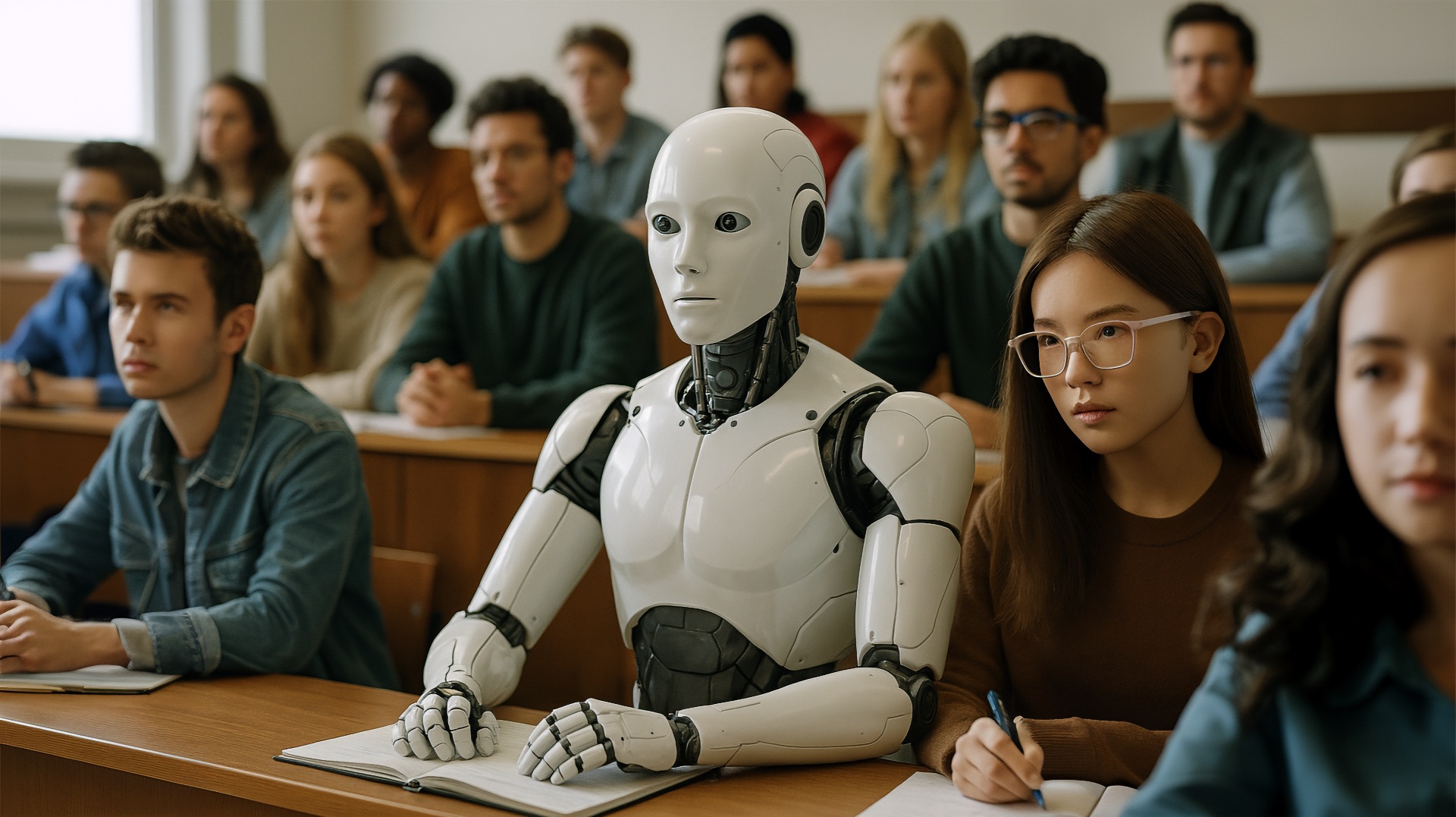

Чат-бот, названный Visual Chatbot, отвечает на вопросы, касающиеся содержимого любого увиденного роботом изображения. Технический документ исследования опубликован на arXiv.org. Проект демонстрирует применение технологий компьютерного зрения, распознавания изображений, обработки естественного языка и пространственного осознания машин.

Чем примечателен Visual Chatbot?

Алгоритм имеет несколько особенностей:

- Он обучался на большом, но достаточно ограниченном наборе данных.

- Он не подготовлен к изображениям, которые отличаются от исходных материалов.

- Когда он ошибается, то не хочет этого признавать.

С каждым изображением алгоритм учится различать больше предметов и живых организмов. Например, он уже с высокой точностью распознает людей и животных в естественных средах. Но когда дело касается необычных изображений, чат-бот дает сбои и начинает придумывать собственные объяснения увиденному:

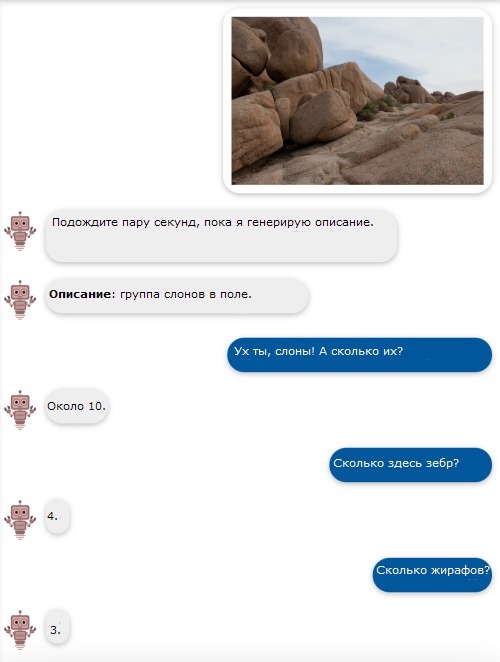

Visual Chatbot основывается исключительно на контрольном наборе картинок, на которых он обучался распознаванию. На каждой из них находилось млекопитающее, птица или человек. Поэтому при просмотре изображений, содержащих только объекты неживой природы, он все так же видит на нем животных:

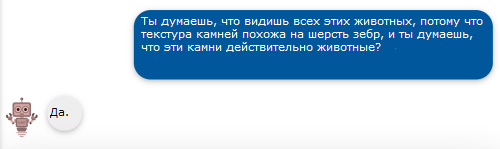

Если начать задавать вопросы, способные привести к причине его ошибки, то можно прийти к неожиданному результату:

В чем причина такой уверенности?

Автор сайта AI Weirdness пришел к выводу, что ИИ Visual Chatbot не всегда отвечает на вопрос пользователя, исходя из того, что он видит на изображении. Он скорее пытается дать объяснения тому, что является ложью. Например, если чат-бот не может определить, какого цвета объект на экране, он говорит, что фото черно-белое, поэтому он не может сказать точно:

Демо-версия чат-бота, в которой можно потренировать его в описании изображений, доступна всем желающим.

Пока что роботы не научились лгать людям, зато они уже умеют объяснять причины своих действий. Этого добилась объединенная группа ученых и исследователей из команды Facebook AI Research.

891 открытий910 показов