Как телеграм-каналы формируют альтернативную реальность: механики манипуляции и алгоритмы страха

Как Telegram-каналы манипулируют восприятием ИТ-индустрии: психологические триггеры и методы защиты

167 открытий2К показов

Каждый день мы заходим в Telegram в поиске новостей из мира ИТ — и погружаемся в водоворот противоречий. Один канал кричит о крахе рынка труда, другой — о тотальной замене разработчиков искусственным интеллектом, третий пишет, что джуны больше никому не нужны. Спустя полчаса скролла возникает ощущение, что индустрия, ещё вчера казавшаяся стабильной, трещит по швам.

Но что если все эти новости и посты не отражают объективную реальность, а создают альтернативную? Telegram, изначально задуманный как свободная площадка для обмена информацией, со временем превратился в гигантский усилитель страхов и спекуляций. Алгоритмы и психология работают в тандеме: чем громче заголовок — тем выше вовлечённость, а значит, и доход владельцев канала. Правда же остаётся где-то там, под слоем сенсаций и упрощений.

Эта статья — инструкция по выживанию в информационном шторме. Узнаем, как тгм-каналы влияют на наше восприятие реальности, почему даже правдивые факты часто подаются под соусом паники, и как оставаться в курсе событий без тревоги и когнитивных искажений.

За что мы любим Telegram и чем он опасен

Telegram — больше чем мессенджер. Для айтишников он стал универсальным инструментом: здесь публикуют вакансии, делятся опытом, обсуждают технологии и читают новости.

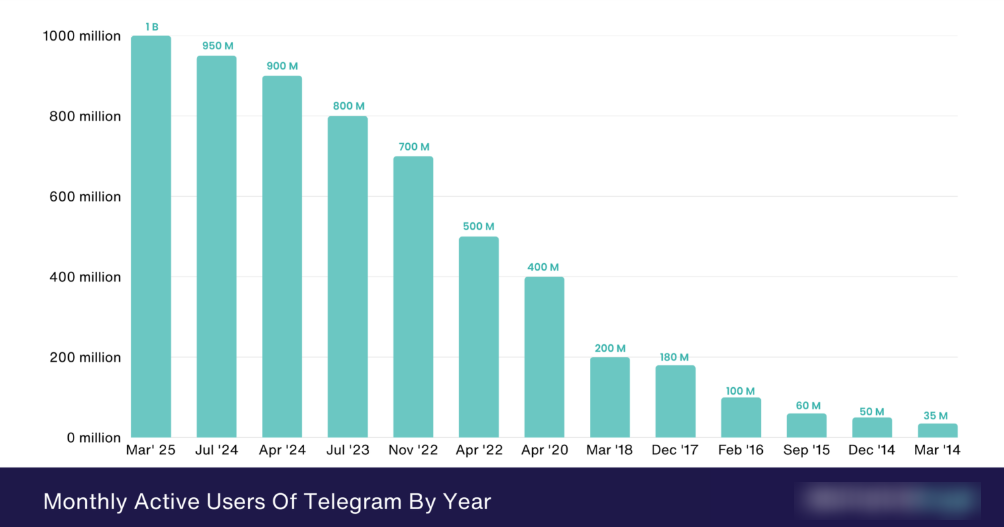

По данным создателей Telegram братьев Дуровых, ежемесячно платформой пользуются около миллиарда человек по всему миру, а в рунете это один из ключевых источников информации для специалистов.

Но у медали есть и обратная сторона — экономика внимания, которая диктует свои правила. Монетизация многих каналов напрямую зависит от охватов, что создаёт естественный стимул использовать любые средства для привлечения внимания.

Эмоциональные триггеры становятся валютой: заголовки в духе «ИИ забрал работу у программистов» генерируют клики, даже если не совсем соотносятся с реальностью.

Это не всегда сознательная дезинформация — скорее, системная особенность.

Алгоритмы Telegram способствуют вирусному распространению сенсаций, а аудитория, находящаяся в состоянии неопределённости, особенно восприимчива к таким сигналам. В результате формируется искажённая картина, где отдельные факты превращаются в тенденции, а исключения — в правила.

Проблема не только в откровенной лжи. Многие каналы используют реальные факты, но подают их под соусом сенсации, упуская нюансы. Например, сокращения в крупных ИТ-компаниях действительно были, но они затронули лишь малую часть рынка. ИИ действительно меняет индустрию, но он скорее дополняет программистов, а не заменяет их.

Однако мессенджеры и СМИ рисуют другую картину, которая меняет наше отношение к реальности. Как это делается на практике и кому выгодно?

Как устроены манипуляции: механизмы влияния на аудиторию

Telegram-каналы используют проверенные приёмы, чтобы удерживать внимание, зарабатывать деньги и формировать повестку. Эти механизмы часто работают на подсознательном уровне, и понимание их — первый шаг к защите.

Эмоциональные триггеры: страх и неуверенность как двигатель вовлечённости

Страх — один из самых мощных инструментов воздействия. Заголовки, которые пугают, вызывают больше реакций и переходов. Это подтверждают исследования, опубликованные в Nature Scientific Reports: контент с негативной окраской чаще распространяется вирусно.

В ИТ-сфере, где изменения происходят быстро, а конкуренция высока, страх остаться без работы или оказаться не у дел особенно актуален. Поэтому темы увольнений, кризиса и угрозы со стороны ИИ так популярны.

Пример: канал публикует новость о сокращениях в крупной компании. Факт может быть правдивым, но подаётся он так, будто это начало конца для всей индустрии. Читатель, особенно начинающий специалист, испытывает тревогу и начинает следить за каналом в поисках новых предупреждений.

Иллюзия экспертизы: почему мы доверяем не тем людям

Многие авторы каналов позиционируют себя как инсайдеры или эксперты. Они используют профессиональный жаргон, ссылаются на неназванные источники и делают уверенные прогнозы. Аудитория, особенно без глубокого опыта, склонна доверять таким фигурам — это когнитивное искажение, известное как эффект ореола.

Однако за громкими заявлениями часто стоит поверхностный анализ. Например, утверждение «ИИ заменит 50% разработчиков к 2030 году» может быть основано на вырванном из контекста исследовании или вовсе на домыслах. Проверить это сложно, поэтому мифы живут и множатся.

Алгоритмическое усиление: как платформа способствует панике

Telegram, как и другие соцсети, использует алгоритмы для рекомендаций контента. Цепляющие и сенсационные посты чаще показываются в релевантных чатах и каналах, что создаёт эффект снежного кома. Даже если первоначальный источник был малозаметным, алгоритм может разнести паническое сообщение по всей сети.

Кроме того, в ТГ активно работают боты и автоматические кросс-посты между каналами. Это позволяет быстро тиражировать непроверенную информацию — иногда она становится вирусной ещё до того, как её успевают проверить.

Эхо-камеры: почему мы видим только одну сторону правды

Многие подписчики ИТ-каналов находятся в своего рода информационных пузырях. Они читают те каналы, которые соответствуют их взглядам, и общаются в чатах с единомышленниками. Это создаёт эффект эхо-камеры — когда определённые мнения многократно усиливаются, а альтернативные точки зрения игнорируются.

Например, если несколько крупных каналов одновременно начинают говорить о кризисе в ИТ, их аудитория воспринимает это как общую правду, даже если данные по рынку говорят об обратном.

Проблема усугубляется тем, что пользователи непреднамеренно формируют поисковые запросы, соответствующие их существующим убеждениям. Исследование, опубликованное в Proceedings of the National Academy of Sciences USA, показывает: около трети запросов формулируются узко и предвзято (например, «риски ИИ» вместо «преимущества ИИ»).

Алгоритмы поисковых систем и соцсетей, включая Telegram, усиливают этот эффект, предлагая контент, который укрепляет существующие убеждения. Даже современные ИИ-поисковики вроде ChatGPT дают результаты, усиливающие изначальные предубеждения пользователя.

Эксперименты демонстрируют, что просмотр альтернативных результатов может менять мнения и даже поведение людей. Участники, видевшие позитивные материалы о ядерной энергии, начинали относиться к ней лучше, а те, кто изучал пользу кофеина, чаще выбирали кофеиносодержащие напитки.

Критически важно осознанно формулировать запросы, проверять альтернативные источники и понимать работу алгоритмов, чтобы избежать искажённого восприятия реальности. Как отмечают исследователи, даже небольшие изменения в алгоритмах — например, принудительное расширение спектра выдаваемых результатов — могли бы смягчить искажения.

Реальность vs. повестка: что на самом деле происходит в ИТ

Чтобы противостоять манипуляциям, важно отделять факты от интерпретаций. В качестве демонстрации объективного подхода разберём уже упомянутые нами темы, которые наиболее часто искажаются в телеграм-каналах.

Рынок труда: нужны ли ещё джуны и что с зарплатами

Один из самых популярных страхов — что вход в ИТ закрыт, а джуниоры никому не нужны. Реальность сложнее. Да, конкуренция на входные позиции выросла: по данным HH.ru, в 2024 году на одну вакансию для начинающего специалиста могло приходиться до 20 резюме. Однако это не значит, что рынок умер — он стал более зрелым.

Крупные компании по-прежнему нанимают джуниоров, но теперь больше внимания уделяют качеству подготовки. Также растёт спрос на смежные специальности — например, DevOps, Data Engineering и AI-разработку. Зарплаты не падают массово, но их рост замедлился — это естественно для зрелой индустрии.

Влияние ИИ: помощник или конкурент?

Тема искусственного интеллекта обросла мифами сильнее других. Часто можно встретить утверждения, что ИИ вот-вот заменит программистов. Но сегодняшние ИИ-инструменты — это в основном помощники, а не замена. Например, GitHub Copilot или ChatGPT ускоряют рутинные задачи, но не способны на сложный дизайн архитектуры или принятие стратегических решений.

Исследование ВШЭ (Высшей школы экономики) показало, что компании, использующие ИИ-инструменты, работают эффективнее. При этом ИИ не отнимает работу, а трансформирует её — по данным GitHub Copilot, теперь программист делает больше за то же время.

Но есть и тревожные новости — как сообщают в Uplevel, использование AI-инструментов приводит к росту числа ошибок в коде. Более того, гендиректор компании Gehtsoft USA Иван Гехт отмечает, что код, сгенерированный ИИ, часто оказывается сложнее для понимания и отладки, чем написанный человеком — порой его эффективнее полностью переписать.

Он подчёркивает, что разработка ПО на 90% состоит из интеллектуальной работы: анализа требований, проектирования архитектуры и учёта ограничений, тогда как непосредственное написание кода остаётся технически более простой задачей.

Кризисы и сокращения: как их преподносят и что на деле

Сокращения в ИТ-компаниях — реальность, но их масштабы часто преувеличиваются. Например, в 2023-2024 годах крупные игроки вроде Amazon и Google действительно сокращали часть сотрудников. Однако в глобальном масштабе эти увольнения затронули менее 5% рынка. Более того, многие из сокращённых быстро находили новую работу благодаря высокому спросу на опытных специалистов.

Проблема в том, что каналы подают каждое такое событие как знак апокалипсиса, не учитывая общую динамику. Рынок ИТ по-прежнему растёт — просто темпы роста замедлились в условиях глобального экономического кризиса.

Психология восприятия: почему мы ведёмся на манипуляции

Зависимость от сенсаций — это не просто слабость, а особенность работы нашего мозга. Понимание этих механизмов помогает сохранять трезвость мысли.

Когнитивные искажения: как мозг упрощает реальность

Наше мышление подвержено системным ошибкам — когнитивным искажениям. В контексте ИТ-новостей наиболее релевантны:

- Подтверждающее отклонение. Мы склонны верить информации, которая подтверждает наши реальные страхи. Если разработчик уже беспокоится о конкуренции, он с большей вероятностью поверит в панические прогнозы.

- Эвристика доступности. Мы переоцениваем вероятность событий, которые легко вспомнить. Яркие заголовки о кризисах и увольнениях запоминаются лучше, чем сухая статистика о росте рынка.

- Эффект Даннинга-Крюгера. Новички в ИТ часто не могут оценить свою компетенцию и потому доверяют «экспертам» из ТГ, даже если те не заслуживают доверия.

Евгений Кот, VP of Engineering @ Rarible, психолог/терапевт (МГИ 2023), ведущий канала Доктор Кот (https://linktr.ee/bunopus):

«Проблема не только в когнитивных искажениях (они есть у всех из нас), сколько в синергетическом эффекте, своего рода "когнитивном шторме", особенно в условиях высокой неопределенности, характерной для IT-сферы. В медленно меняющихся отраслях меньше истерии, но и награда меньше. Это подкрепляется мнением, что мол "айтишники зажрались", которое можно прочесть как "ты переоценён, ты столько не стоишь, это просто удача". Совсем не добавляет уверенности. Вот в таких условиях все три искажения складываются друг с другом в когнитивный капкан.

Подтверждающее отклонение (Confirmation Bias) работает на том, что мозгу проще согласиться с пусть и плохой, но зато простой и понятной информацией. "Рынок рухнул" – больше ничего добавлять и не надо. Особенно если человек склонен к драматизации и пессимизму. Мозг стремится к состоянию внутреннего психологического комфорта и будет активно искать или интерпретировать информацию так, чтобы она согласовывалась с уже существующими убеждениями или принятыми решениями. Festinger, L. (1957). A Theory of Cognitive Dissonance. Stanford University Press.

Эвристика доступности (Availability Heuristic) как понятие оригинально появилась в классической работа Даниэля Канемана и Амоса Тверски. Они показали, что люди оценивают частоту или вероятность события по легкости, с которой примеры приходят на ум. Эвристика доступности работает особенно мощно, когда информация не просто яркая, а эмоционально заряженная (страх, гнев, паника). История об увольнении конкретного человека с его переживаниями (эмоциональный нарратив) запомнится и будет казаться более вероятным событием, чем сухая статистика о найме тысяч специалистов. И, как уже было упомянуто, существует "каскад доступности" — когда медиа запускают цепную реакцию, в которой незначительное событие раздувается до масштабов катастрофы, потому что о нем все говорят. Все мы помним знаменитый мем про журналистов и учёного.

Ну и наконец про уже набивший оскомину Эффект Даннинга-Крюгера. У него есть и обратная сторона. А она в том, что высококлассные специалисты и настоящие эксперты склонны недооценивать свои знания и способности, поэтому чаще всего высказываются осторожно и неинтересно в духе "ну, это зависит от...". В контексте Telegram-каналов это создает опасную ситуацию: громче всех кричат уверенные в себе дилетанты, в то время как настоящие эксперты молчат и думают, из-за чего их мнение тонет в общем шуме.

Лет десять назад для всех стало открытием, что, помимо технических навыков стоит развивать и софт скиллы. Тогда казалось, что с айтишников спрашивают и так слишком много. В наше же тревожное время и этого мало. На первый план выходят метакогнитивные навыки, то есть "умение думать о своем мышлении". Каждый раз, когда вы видите "заряженный" пост, который вас расстраивает, злит или пугает, спросите себя: "Какую эмоцию я сейчас испытываю?", "Насколько вероятно, что такое происходит везде, достаточно ли приведено ссылок на статистику или это единичный случай?" ну и самое важное: "Является ли автор этого поста признанным экспертом, или он просто говорит очень уверенно?".

Забота о своём ментальном здоровье не менее важна, чем забота о своём теле. И, если идея о том, что не стоит пихать в себя фастфуд и сладкое тоннами уже примерно понятна всем, то идее фильтрации потребляемого контента ещё предстоит прорасти в умах потребителей. А пока — "не читайте до обеда Телеграмм каналов"».

Эти искажения делают нас уязвимыми перед манипуляциями — особенно когда мы сталкиваемся со сложными и неопределёнными ситуациями.

Социальное доказательство: почему мы верим толпе

В условиях неопределённости мы склонны ориентироваться на поведение других. Если все вокруг говорят о кризисе, мы начинаем верить в него даже без прямых доказательств. Это называется социальным доказательством — механизм, который часто используют каналы, накручивая активность через ботов или создавая видимость массового обсуждения.

Например, канал может опубликовать опрос «Верите ли вы, что ИТ-рынок в упадке?» с заранее подготовленными вариантами ответов. Даже если большинство участников выберут положительный ответ, это не будет отражать реальность — лишь мнение конкретной аудитории.

Как защитить себя: практические советы по потреблению контента

Осознание проблемы — уже половина решения. Вот несколько конкретных шагов, которые помогут сохранить ясность мысли и не поддаваться панике.

Развивайте медиаграмотность: проверяйте источники

Не принимайте информацию на веру — всегда ищите первоисточники. Если канал утверждает, что «70% компаний перестали нанимать джуниоров», спросите: откуда эти данные? Кто проводил исследование? Часто оказывается, что за громкими цифрами стоит опрос среди десяти друзей автора.

Полезно подписаться на проверенные источники: официальные блоги компаний, исследования авторитетных организаций вроде Stack Overflow или Gartner, академические журналы. Например, ежегодный опрос Stack Overflow среди разработчиков — отличный источник реальных данных о трендах индустрии.

Диверсифицируйте ленту: выходите из пузыря

Не ограничивайтесь Telegram — используйте разные платформы и форматы. Подпишитесь на проверенные профильные издания, например, на Tproger или IEEE Spectrum, читайте блоги технологических компаний, участвуйте в профессиональных сообществах.

Важно также слушать разные точки зрения. Если вы читаете только те каналы, где критикуют ИИ и пугают Скайнетом, добавьте те, которые демонстрируют потрясающие возможности нейросетей. Это поможет сформировать более сбалансированную картину.

Учитесь распознавать манипулятивные приёмы

Обращайте внимание на язык и подачу. Манипулятивные каналы часто используют:

- абсолютные утверждения: «все», «никогда», «категорически»;

- призывы к эмоциям: «сенсация», «закрытые источники»;

- неопределённые ссылки: «эксперты говорят», «исследования показали» без конкретики.

Напротив, качественные источники обычно приводят данные, признают ограничения и избегают категоричных прогнозов.

Отслеживайте своё состояние: не давайте тревоге взять верх

Если чтение ленты вызывает стресс или тревогу — сделайте перерыв. Помните, что ваша ценность как специалиста определяется не заголовками в телеграме, а реальными навыками и опытом.

Практикуйте осознанное потребление контента: выделите определённое время на чтение новостей, а не проверяйте их постоянно. И если какой-то канал постоянно вызывает негативные эмоции, смело отписывайтесь — ваше ментальное здоровье дороже сомнительной осведомлённости.

Итоги: как оставаться в курсе без потери адекватности

Telegram-каналы — удобный инструмент, но они не должны быть единственным источником информации. Индустрия ИТ действительно меняется: растут требования к специалистам, появляются новые технологии, рынок становится более зрелым. Но это не кризис — а естественное развитие.

Ключ к адекватному восприятию реальности — в критическом мышлении и разнообразии источников. Проверяйте факты, развивайте экспертизу и не поддавайтесь панике. Как показывает практика, ИТ остаётся одной из самых динамичных и перспективных индустрий — просто теперь для успеха в ней требуется не только умение кодить, но и способность отделять сигнал от шума.

167 открытий2К показов