Как защитить конфиденциальные данные в ChatGPT

Рассказали, почему ChatGPT выдает конфиденциальные данные и какую личную информацию не стоит доверять нейросетям.

2К открытий7К показов

Елена Кравченко — предприниматель, нейромаркетолог, эксперт в области искусственного интеллекта — о том, почему ChatGPT выдает конфиденциальные данные и какую информацию не стоит доверять нейросетям.

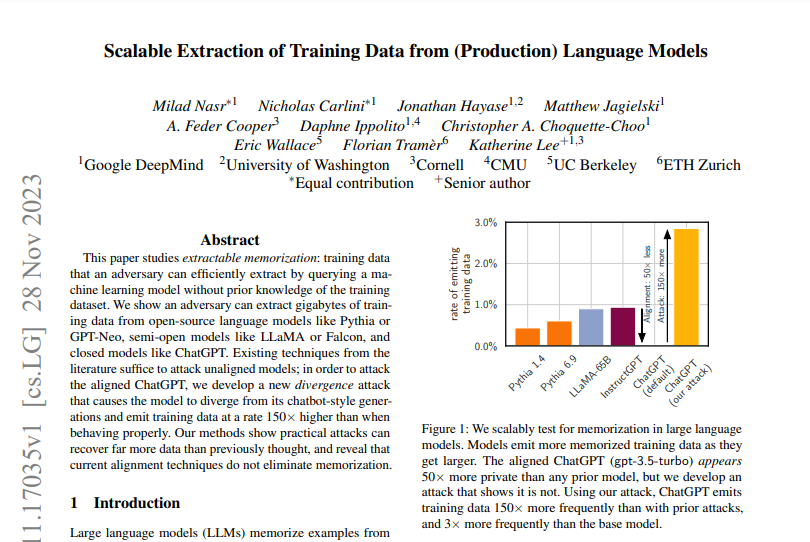

Международная группа ученых заявила, что популярный чат-бот ChatGPT может выдавать случайным пользователям гигабайты конфиденциальных данных. Исследование опубликовано на сервере препринтов arXiv.

Откуда у ChatGPT огромные массивы конфиденциальных данных

Огромные массивы конфиденциальных данных у ChatGPT из интернета. Данная модель обучалась на текстовых данных интернета. Их массив огромен – это книги, статьи, сайты. Кроме того, у ChatGPT есть память и данные из разговора могут быть использованы в общении с другими пользователями.

Важно понимать, пользователи сами загружают во всемирную сеть все свои данные. Идет постоянная пересылка, люди делятся между собой. Все что есть в интернете, все есть в ChatGPT.

Здесь не вопрос конфиденциальности, которая должна соблюдаться, а в том, что люди сами размещают эти данные.

Важно понять, что в искусственный интеллект постоянно загружается большая база данных из интернета. Соответственно, если какая-то статья или фрагмент книги где-то были выложены, то они автоматически попали в нейросеть. Причем, публиковать данные может или сам автор (владелец), либо любое другое лицо, у которого был доступ к данным.

Происходит ли похожее накопление у других нейросетей

У ChatGPT и Midjourney авторские права на законодательном уровне пока не определены, система только разворачивается. А, например, все что сгенерировано нейросетями “Сбербанка”, защищено авторским правом и принадлежит ему. Со “Сбербанком” проще, так как это в рамках одной страны.

Идет накопление во всех нейросетях, точно также, как и во всем интернете. Это тоже самое, если спросить: “Накапливает Яндекс или Гугл данные о своих пользователях?”. Ответ: “Да, накапливает”. Тут та же самая история.

Как и почему к данным могут получать доступ посторонние лица

Если вы залили в открытое пространство информацию о себе, то любой ее может получить. Никакой подоплеки нет, если сам человек выгружает данные, то и другие люди могут их скачать.

Ученые заявили, что у них оказались данные, защищенные авторским правом: статьи из закрытых журналов и фрагменты книг, якобы которых не было в открытом доступе. Но поймите, например, вышел журнал, третьи лица его могли сфотографировать, скопировать и выложить в интернет. И таким образом данные оказались у нейросетей. И это не означает, что сам автор материала открыл доступ к статье. Возможно, статья или книга были написаны с помощью нейросети. Это тоже самое, как с пиратскими фильмами. Копирование уходит в интернет. Ничего не поделать.

Многие сейчас используют нейросети для работы. Например, hr часто создают вакансии с помощью нейросетей и загружают туда персональные данные. Пользователи должны сами принимать меры предосторожности. Не нужно писать в ChatGPT свои персональный данные, финансовую информацию о компании и другие сведения, которые могут представлять риск. Эта ответственность лежит на каждом человеке.

Эволюционная и технологическая революция произошли, но юридическое право в этой области пока не дотягивает. Пока намного больше вопросов, чем ответов, как это регулировать.

Чем могут быть опасны подобные утечки

Были колоссальные утечки и с Яндекса и других источников, все тоже самое. Здесь вопрос в том, еще раз, что эти данные загружает сам человек и именно он несет ответственность. Провайдер или нейросети не могут нести ответственность за то, что пользователь сам им отправил свои данные.

Пример, человек составляет резюме, а в нем указаны все его персональные данные. Или он пересылает скан своего паспорта.

Какие данные не стоит доверять нейросетям, чтобы не пострадать от подобных утечек. Как защититься

Когда вы что-то запрашиваете у нейросетей и отправляете на проверку – не ставьте туда свои реальные данные: где вы живете, паспортные данные и тогда ими никто не воспользуется

Мы пришли в эру “все что происходит – ответственность на мне”. Про любого человека или организацию можно найти информацию в сжатые сроки, если кто-то до этого выложил про нее информацию в интернет. Я повторюсь, это могут быть не владельцы компании или сам человек, а третьи лица.

Другими словами, в ChatGPT не попадает то, чего ранее не было в интернете или в самом чате.

При этом, создается огромное количество институтов и законов о сохранении персональных данных. Но, к сожалению, мы видим, что постоянно просачивается информация, происходят сбои и сливы данных.

Поэтому, когда вы привязываете свою карточку к какому-то ресурсу, посмотрите сможете ли вы потом удалить, будет ли у вас доступ к сайту и тд. Тоже самое и для компаний, не нужно никуда выкладывать секретные технические и финансовые данные организации.

Ограничение использования ChatGPT на рабочих местах – одна из самых эффективных мер. Например, так сделала компания JPMorgan. Также можно провести переговоры с сотрудникам об осторожности и мерах ответственности при использовании нейросетей.

Важно повышать свою кибергамостноть, тогда утечки личных данных или компаний будут невозможны.

2К открытий7К показов