Нейросеть Shap-E создаёт 3D-модели по тексту в стиле первой PlayStation

Новости

Компания OpenAI представила Snap-E — модель, которая способна генерировать 3D-модели по текстовому запросу.

3К открытий5К показов

Shape-E – это вторая попытка OpenAI создать модель, которая могла бы создавать 3D-модели. Получить доступ к файлам и документации можно на странице GitHub. Все разработки Shap-E находятся в открытом доступе.

Установить Shape-E можно через pip:

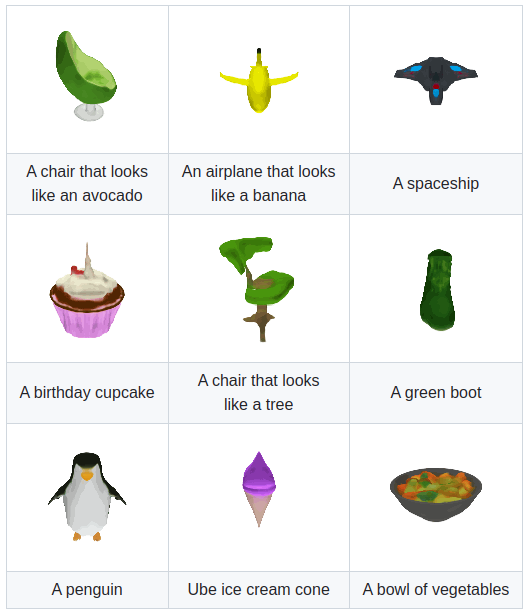

Вот примеры моделей, сделанных Shape-E:

- sample_text_to_3d.ipynb — образец 3D-модели, созданный по текстовой подсказке.

- sample_image_to_3d.ipynb — образец 3D-модели, основанный по изображению. Чтобы улучшить результат, нужно удалить фон из входного изображения.

- encode_model.ipynb — образец 3D-модели с пакетом многоракурсных рендеров и облаком точек. Shape-E может кодировать их в скрытую форму и визуализировать обратно. Для этого нужно установить Blender 3.3.1 и выше и задать для переменной BLENDER_PATH путь к исполняемому файлу Blender.

Первой попыткой была Point-E, которая вышла в конце 2022 года одновременно с ChatGPT. Главной причиной неудачного запуска Point-E стали беспорядочные результаты, которые сильно отличались от промптов.

Shap-E находится на ранней стадии разработки, но уже может создавать 3D-модели по промптам, и модели потенциально можно распечатать.

Исследователи в качестве примера показали модели “дорожный конус”, “стул, похожий на дерево” и “самолет, похожий на банан”. Результаты сильно напоминают графику на первой PlayStation.

Больше примеров можно посмотреть здесь.

Нагенерированные модельки можно подправить в 3ds Max, Autodesk Maya или Blender.

Shap-E — это:

Круто, можно использовать как помощника для быстрого рендера

Отстой, не доделано. Такие модели можно и самому слепить без всяких нейронок

Хотя качество визуализации Shap-E отстаёт от качества конкурентов, она гораздо быстрее генерирует 3D-модели: ей требуется 13 секунд на основе текстовой подсказки.

Также рендеринг Shap-E отличается мягкими краями, четкими тенями и меньшей пикселизацией, чем у Point-E. При этом для генерации 3D-модели не нужна картинка-референс.

Сейчас OpenAI продолжает работать над Shap-E. Исследователи отмечают, что грубые результаты могут быть сглажены с помощью других генеративных 3D-программ.

В будущем OpenAI направит свои усилия на создание 3D-моделей огромных размеров.

3К открытий5К показов