🔥 xAI представила grok-code-fast-1 — свою первую ИИ-модель для кодинга и агентных задач

Новости

И которая уже показывает впечатляющие результаты!

455 открытий7К показов

Компания xAI анонсировала grok-code-fast-1. Это первая модель компании, ориентированная на программирование и агентные сценарии.

Модель создана с нуля, обучена на реальных пулл-реквестах и задачах из практики. Она уже доступна в IDE.

Новая глава в «вайб-кодинге»

Модель grok-code-fast-1 от xAI позиционируется как конкурент решениям от OpenAI, Google и Anthropic. Она оптимизирована для разработки на TypeScript, Python, Java, Rust, C++ и Go, а значит покрывает большинство реальных кейсов в современной разработке.

Модель уже интегрирована в IDE и CLI вроде GitHub Copilot, Cursor, Cline, Roo Code, Kilo Code, OpenCode и Windsurf. В ближайшее (но ограниченное) время она будет доступна бесплатно.

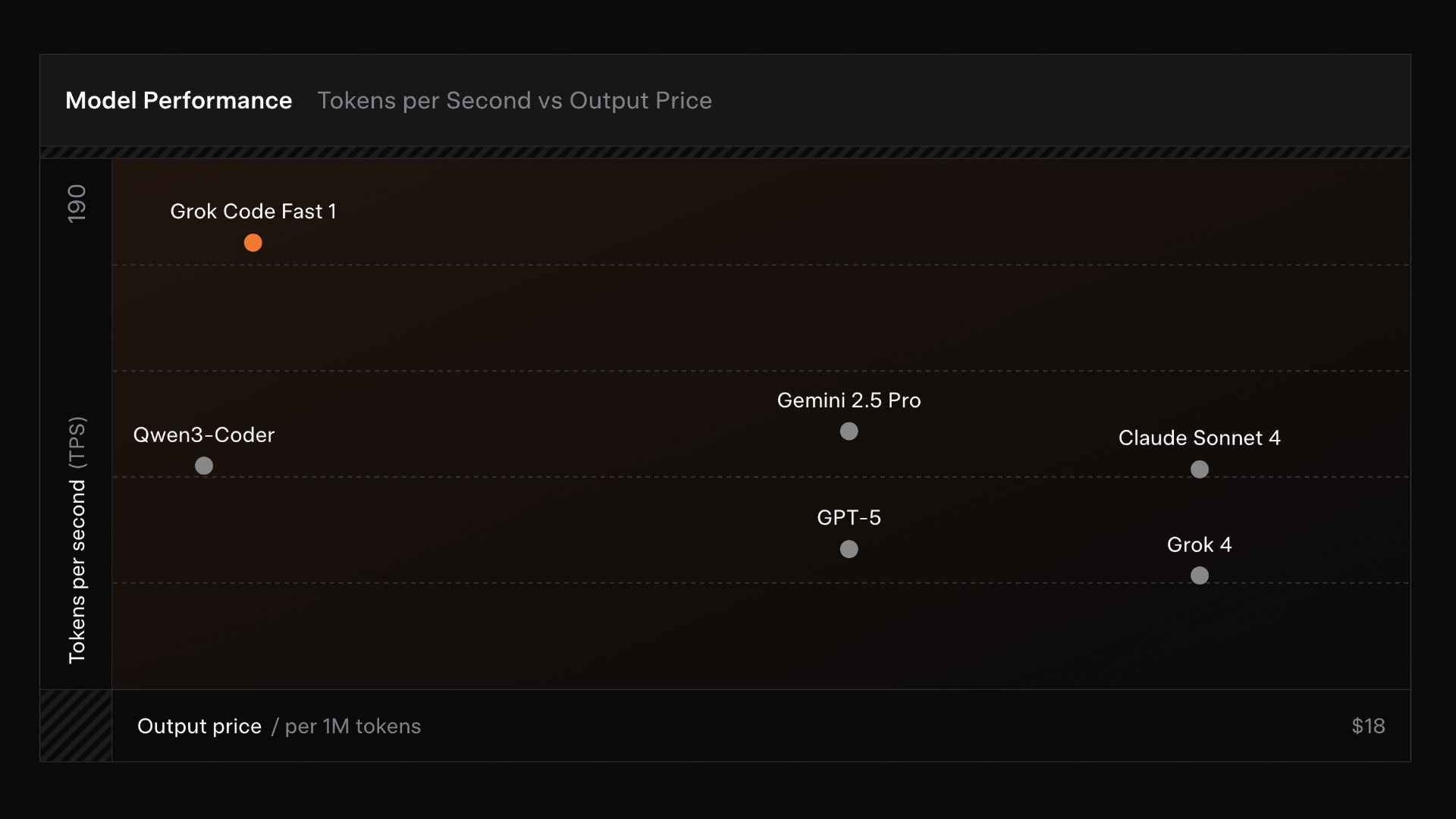

Быстрая, дешевая и довольно-таки умная

xAI делает ставку на цену, скорость и удобство. Стоимость использования grok-code-fast-1:

- $0,20 за 1 млн входных токенов

- $1,50 за 1 млн выходных токенов

- $0,02 за 1 млн кэшированных входных токенов

Во внутреннем бенчмарке SWE-Bench-Verified, модель показала результат 70,8%, но независимых тестов пока нет — их ждут в ближайшие недели.

В xAI утверждают, что при создании модели основное внимание уделялось практическому использованию и удобству в реальных задачах. Якобы разработчики оценили grok-code-fast-1 как «быструю и надежную» при повседневной работе с кодом.

До 160 токенов в секунду и 90% кэш-хитов

Команды xAI по инференсу и суперкомпьютингу применили ряд новых приемов, чтобы ускорить генерацию до 160 токенов в секунду. Особенно это ощущается в IDE, где задержка — критический параметр.

Кроме того, реализовано кэширование подсказок, которое обеспечивает до 90% попаданий при работе с GitHub Copilot и другими интеграциями. Это позволяет существенно сократить задержки и стоимость использования.

455 открытий7К показов