Главное из Google I/O 2025: как они строят свою ИИ-империю

Всё, что вы пропустили на Google I/O: Gemini 2.5, Deep Think, Flow, XR-очки и подписка за $250. Кому нужно и стоит ли брать — краткий гид.

356 открытий5К показов

На Google I/O 2025 компания показала, как будет выглядеть новый интернет: с ИИ, который пишет код, монтирует видео, управляет задачами и смотрит через камеру смартфона.

Всё это — в новом пакете Google AI Ultra: от флагманской модели Gemini 2.5 до продвинутых XR-очков и голосовых ассистентов.

Мы собрали гид по самым важным новостям конференции.

Новые модели Gemini — что изменилось

Сергей Брин, который почти вышел на пенсию во время пандемии, вчера появился в Маунтин-Вью на Google I/O 2025, чтобы помочь с багом DeepMind во время демо новой AI-системы. Теперь он участвует в обучении ключевых моделей Gemini и мультимодальных систем.

Новейшая версия Gemini 2.5 Flash стала флагманом доступной производительности и скорости. Её оптимизировали на 22% быстрее, чем Gemini 2.0 Flash, в итоге версия показала лучшие результаты в задачах кодирования и логики.

- В задачах программирования модель показывает 61.9% точности в whole evaluation и 56.7% в diff-настройке.

- Цена за использование $0.10 за ввод 1М токенов и $0.40 за вывод, по факту самый выгодный вариант среди всех моделей в сравнении.

Flash 2.5 обходит Claude Sonnet 3.7 и Grok 3 в большинстве бенчмарков и догоняет GPT-4 Turbo в задачах reasoning.

Deep Think — эксклюзивный режим для подписчиков

Для разработчиков, ученых и аналитиков Google представила Deep Think — улучшенный режим рассуждения для модели Gemini Pro 2.5. Он создан для:

- сложной математики (например, AIME/AMC),

- написания алгоритмически сложного кода,

- построения агентных цепочек и работы с графами,

- задач, требующих нескольких шагов размышления.

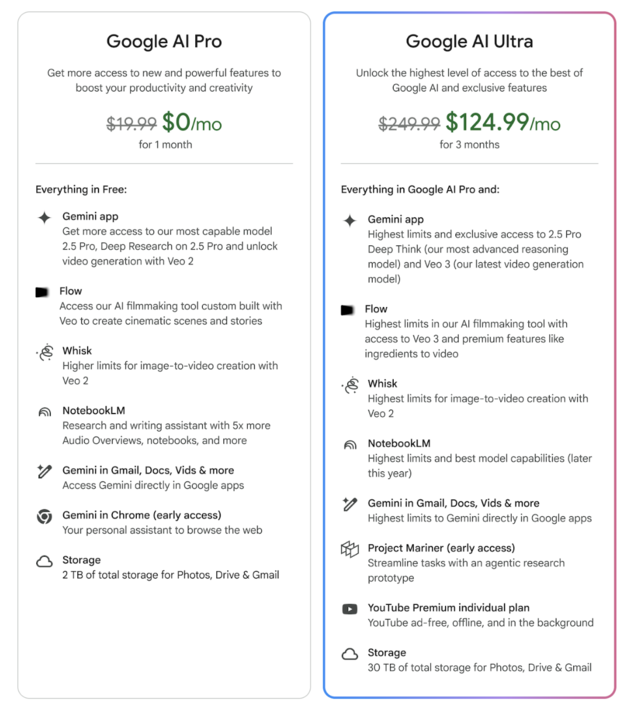

Deep Think официально доступен только по подписке Google AI Ultra ($249.99/мес), но в Google AI Studio он временно бесплатный.

Альтернатива OpenAI и Anthropic?

Да. Google теперь играет на всех полях:

- Flash 2.5 дешевле и быстрее GPT-4 Turbo.

- Deep Think конкурирует с Claude Opus и OpenAI o4-mini, обеспечивая высокий уровень reasoning и поддержку множественных шагов.

- Модель доступна в Chrome, Gmail, Gemini App, и в AR-очках.

Что интересно для разработчиков

- Gemini теперь интегрирован в Google Labs, где появился инструмент Stitch — он преобразует текстовые описания и референсные изображения в полноценные UI-макеты с кодом.

- Также запущена публичная бета Jules — coding agent, который может писать фичи, чинить баги и даже озвучивать изменения как подкаст. Бесплатно, пока в тесте.

$250/мес: стоит ли платить за Google AI Ultra?

Среди всех анонсов на Google I/O 2025 один вызвал больше всего вопросов и споров: новая подписка Google AI Ultra за $249.99 в месяц. Дорого? Безусловно.

Но AI Ultra — это не одна модель, а доступ к облаку инструментов от Google:

Gemini 2.5 Pro с режимом Deep Think.

- Может решать задачи уровня олимпиад (AIME, AMC), сложную математику, писать продвинутый код и проводить многошаговое рассуждение.

- Доступен только в подписке, за исключением бесплатного тестирования через AI Studio.

Veo 3 — генерация видео с физикой, звуком и сюжетом.

- Создаёт клипы с логичным движением, встроенным звуковым сопровождением и реалистичной анимацией.

- Впервые AI понимает не просто кадры, а структуру сцен.

Flow — визуальный монтаж и генерация видео из сценариев.

- Можно задать текст, картинки или видеофреймы — AI сам соберёт сцены, сшитые монтажом.

- Подходит для продакшн-команд, маркетинга и motion-дизайнеров.

Imagen 4 — новый стандарт в генерации изображений.

- Способен корректно писать текст в изображении, передаёт мельчайшие детали: мех животных, капли воды, фактуру ткани.

- Быстрее конкурентов, включая GPT-Im1.

Gemini Live / Chrome AI Mode / Project Astra

- Получаете ранний доступ к функциям, которые появятся в массовых продуктах через 2-3 месяца.

- Голосовое управление браузером, умный контекст из вкладок, авто-ответы с учётом всей информации из Gmail, Drive, Chat.

30 ТБ облачного хранилища + доступ к агентному управлению задачами (Project Mariner)

- Можно запускать до 10 AI-задач параллельно.

- Инфраструктура подготовлена под многопользовательские и кросс-сервисные кейсы.

В AI Studio от Google — временно открыт доступ к Deep Think бесплатно для исследовательских целей. Однако остальной стек (Veo, Flow, Mariner) остаётся за платным доступом.

Flow, Veo 3 и Imagen 4 — новая генерация креатива

Flow — это новый AI-видеоредактор от Google, впервые представленный как часть пакета AI Ultra. Он умеет:

- генерировать короткие клипы (8 секунд) на основе текста или картинок (text-to-video и ingredient-to-video);

- сшивать сцены в единую последовательность с помощью инструмента SceneBuilder;

- сохранять стилистику, ритм и содержание между кадрами;

- использовать виртуальные камеры, менять ракурсы, масштаб, динамику сцены.

Flow не только создает видео, он его монтирует. Работает в связке с Imagen 4 и Veo 3, получает от них изображения и анимации, и превращает их в готовый клип.

Veo 3 — новая видеомодель от Google под капотом Flow. Её главные фишки:

- понимание физики объектов: движения выглядят реалистично, учитываются инерция, гравитация и столкновения;

- нативная генерация звука: в видео автоматически добавляются звуковые эффекты, диалоги, фоновые шумы;

- стабильность кадров: анимации не прыгают от фрейма к фрейму, как это часто случается в других генеративных системах.

Veo 3 доступна прямо сейчас в рамках подписки AI Ultra.

Дальше Google показали Imagen 4 — следующее поколение своей модели для генерации изображений.

- точность текстов и типографики: Imagen 4 умеет писать внутри изображений — логотипы, лейблы, инфографика;

- повышенная детализация: от мокрой шерсти животных до сложных фактур, вроде шелка или льда;

- поддержка как фотореализма, так и абстрактных стилей: от съемки натюрморта до генерации сюрреалистичных композиций.

Google обещают, что Imagen 4 генерирует изображения в 3 раза быстрее GPT-Im1 при аналогичном качестве.

Gemini в Chrome, Gmail, Search, XR

Один из самых масштабных системных шагов Google — это интеграция моделей Gemini в каждый цифровой опыт пользователя. Браузер, почта, поиск, документы, видеозвонки, голосовые команды, XR-очки — везде теперь есть AI, и в большинстве случаев — именно Gemini.

Gemini в Chrome — AI как встроенный ассистент

Теперь, если вы пользуетесь Chrome Beta, Dev или Canary, вы можете попробовать AI Mode: ассистента, встроенного прямо в браузер. Он:

- делает сводки по открытым вкладкам;

- ищет информацию в режиме agentic chat;

- запоминает, что вы просматривали и предлагает следующее действие;

- позволяет управлять поиском и действиями голосом.

Gmail с ИИ-ответами на стероидах

Если раньше Smart Replies в Gmail предлагали стандартные «Ок!» и «Спасибо», то теперь, с поддержкой Gemini, всё меняется:

- ответы становятся длиннее и персонализированнее;

- AI тянет контекст не только из текущей переписки, но и из вашего Google Drive, других писем, календаря и заметок;

- отвечает в вашей манере общения — по стилю, формулировкам и даже пунктуации.

Пока функция в бета-режиме и работает в рамках подписки AI Pro или AI Ultra.

Google Search теперь с AI Mode

Теперь в Google Search появился новый таб — AI Mode. Он выглядит как обычный поиск, но с возможностью:

- ввести запрос и получить не только ссылки, но и сводку, рассуждения и объяснения от AI;

- задавать уточняющие вопросы без перезагрузки страницы;

- использовать персональный контекст (ваши интересы, историю запросов, локацию) для формирования ответов.

Gemini Live — ваш AI смотрит через камеру

С функцией Gemini Live, доступной в Android и iOS (через приложение Gemini), можно:

- включить камеру и показать AI, что вы видите;

- спросить: "что это за растение?", "какой это кабель?", "как приготовить это блюдо?";

- получить ответы, инструкции и даже пошаговые рецепты — в реальном времени, без фото и без текста.

Это продолжение проекта Astra, только теперь — в массовом доступе.

XR-очки с Gemini — AI прямо перед глазами

Google представила сразу два проекта в области носимой реальности:

- Project Aura (в партнерстве с Xreal) — AR-очки с прозрачным дисплеем и встроенным Gemini.

- Project Moohan (с Samsung) — полноценная XR-гарнитура в стиле Apple Vision Pro.

Очки умеют:

- распознавать объекты;

- выводить подсказки и инструкции;

- работать в режиме Hands-Free UI с голосом и жестами;

- подключаться к вашему Google-аккаунту и использовать AI Mode, Agent Mode и другие ассистенты.

ИИ-агенты и Project Marine

Google представила Agent Mode — режим, где Gemini берёт на себя управление задачами:

- может выполнять до 10 задач параллельно (поиск, написание, анализ, сводки);

- интегрирован в Google Docs, Gmail, Sheets и даже системные функции;

- работает на модели Project Mariner и доступен пока только подписчикам AI Ultra.

Железо нового поколения: XR-очки, Google Beam и Project Astra

Google много раз повторил, что не просто учит ИИ думать — он ищет способы максимально встроить его в нашу повседневную реальность.

Project Aura: умные очки, которые выглядят как обычные

Project Aura — это платформа Android XR и линейка AR-очков от Google и Xreal, представленных как альтернатива Meta Ray-Ban и Apple Vision Pro, но без огромных шлемов.

Особенности:

- Google объединилась с Warby Parker и Gentle Monster, чтобы сделать очки, которые хочется носить ежедневно;

- интеграция с Gemini Live и Agent Mode: очки могут выполнять команды, видеть то, что видите вы, и подсказывать в реальном времени;

- разработаны как “optical see-through XR device” — с возможностью наложения контента на реальный мир.

Project Moohan — XR-шлем

Разработан в партнёрстве с Samsung и ориентирован на более глубокую иммерсивность, чем очки Aura. Это полноценный XR-хедсет, сравнимый с Apple Vision Pro, но на Android.

Он также работает с Gemini и будет продвигаться через Android XR платформу.

Google Beam — 3D-видеозвонки

Бывший Project Starline, теперь он называется Google Beam.

Это трёхмерная система видеосвязи, которая использует:

- шесть камер для захвата вашего облика с разных углов;

- систему трекинга головы, которая «ведёт» ваше лицо в реальном времени;

- световое поле, создающее эффект реального присутствия без очков и шлемов.

Google заявляет, что Beam скоро появится в офисах — первые поставки будут совместно с HP.

Project Astra — AI-ассистента будущего

Как объясняет Google DeepMind, Astra — это концепт-кар. Пока доступен только узкому кругу тестеров.

Но технологии из него уже приходят в массовые сервисы, например, в Gemini Live, Agent Mode и в Gmail.

Что делает Astra:

- видит, слышит, запоминает;

- делает что-то за вас — даже без команды;

- распознаёт объекты, взаимодействует с компьютером, реагирует на окружение.

Google обозначила стратегию: не конкурировать с OpenAI и Anthropic, а создать экосистему, где ИИ встроен во все уровни пользовательского и профессионального взаимодействия.

Модель Gemini 2.5 Flash стала наиболее доступной по соотношению цена/производительность, опережая Claude Sonnet и Grok в большинстве сценариев. Платформа AI Ultra — это стек продуктов: генерация видео (Veo 3, Flow), изображений (Imagen 4), голосовое взаимодействие (Gemini Live), XR-интерфейсы (Aura, Moohan), а также интеграции с Chrome, Gmail, Search и агентное управление задачами через Project Mariner.

Оценку можно составить на уровне презентации, но самое адекватное получится после того, как технологии выйдут в массу, как это будет работать, при каких сценариях — всё ещё нам предстоит узнать.

Пока все обсуждают новости, мы сделали то, что реально экономит часы: гайд по 70+ ИИ-инструментам.

Статья будет обновляться, сохраняйте.

356 открытий5К показов